Die Serie The Walking Dead gehört zu den bekanntesten dystopischen Geschichten unserer Zeit. Basierend auf den Comics von Robert Kirkman zeigt sie nicht nur eine Zombie-Apokalypse – sondern vor allem, was vom Menschen übrig bleibt, wenn die Welt zerfällt.

Worum geht es?

Nach dem Ausbruch einer globalen Katastrophe erwacht Rick Grimes in einer Welt, die nicht mehr existiert, wie er sie kannte.

Die Zivilisation ist zusammengebrochen.

Gesetze haben keine Bedeutung mehr.

Überleben ist das einzige Ziel.

Gemeinsam mit anderen Überlebenden kämpft er sich durch eine Welt voller:

- Untoter („Walker“)

- rivalisierender Gruppen

- moralischer Grenzsituationen

Mehr als nur Zombies

The Walking Dead ist keine klassische Horrorserie.

Die eigentliche Bedrohung sind nicht die Zombies. Es sind wie immer die Menschen.

Die Serie zeigt sehr eindrucksvoll, wie schnell Ordnung zerfällt, wie Macht neu verteilt wird und wie dünn die Grenze zwischen Gut und Böse ist.

Dystopie pur: Die Welt nach dem Zusammenbruch

Typische dystopische Elemente sind hier besonders stark ausgeprägt:

Gesellschaftlicher Kollaps

Keine Regierung, keine Struktur, keine Sicherheit

Neue Machtstrukturen

Gruppen bilden eigene Regeln – oft brutal

Moralische Entscheidungen

Was ist richtig, wenn es keine Regeln mehr gibt?

Überleben als einziger Zweck

Menschlichkeit wird zur Herausforderung

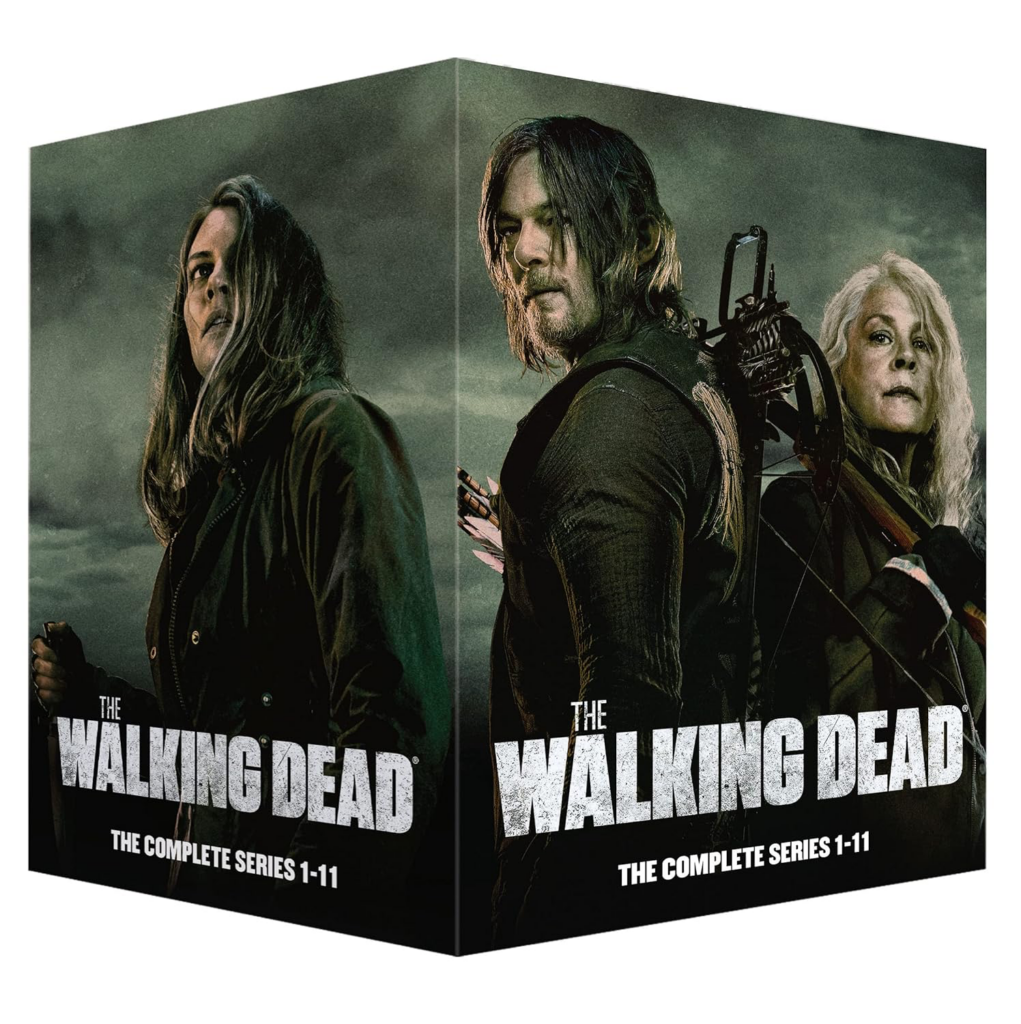

Charaktere im Ausnahmezustand

Die Stärke der Serie liegt in ihren Figuren:

- Rick Grimes – vom Gesetzeshüter zum Anführer

- Daryl Dixon – der Einzelgänger mit Herz

- Carol – eine der stärksten Entwicklungen der Serie

Jeder Charakter verändert sich – oft drastisch.

Genau das macht die Serie so intensiv.

Warum The Walking Dead so erfolgreich ist

Die Serie verbindet:

- Spannung

- emotionale Tiefe

- gesellschaftliche Fragen

Sie stellt uns immer wieder dieselbe Frage:

Was würdest du tun, um zu überleben?

Bedeutung für das Dystopie-Genre

The Walking Dead hat das Genre nachhaltig geprägt:

- Zombies wurden wieder mainstream

- Fokus verlagerte sich auf Menschen statt Monster

- Serienformat statt klassischer Film

Eine moderne Dystopie, die näher an der Realität ist, als man denkt.

Fazit

The Walking Dead ist weit mehr als eine Zombie-Serie.

Sie ist ein düsteres Gedankenexperiment darüber, wie fragil unsere Gesellschaft wirklich ist.

Und vielleicht auch eine Warnung.

Jetzt entdecken